Знаменитый ученый-компьютерщик Джеффри Хинтон, которого называют “крестным отцом искусственного интеллекта”, заявил, что уходит из технологического гиганта Google и теперь готов открыто говорить об опасностях, связанных с развитием технологий в этой области. При этом Хинтон подчеркнул, что его критика не касается лично Google: подход компании к ИИ он наоборот назвал ответственным.

В комментарии Би-би-си Хинтон также предупредил о попадании ИИ-технологий в руки влиятельных злоумышленников – например, как он выразился, российского президента Владимира Путина.

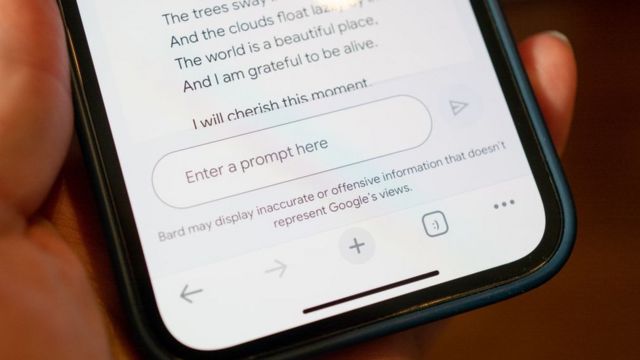

Ученый назвал “довольно страшными” опасности, связанные с развитием ИИ-чатботов.

“Они пока еще не настолько интеллектуально развиты, как мы – по крайней мере, насколько мне известно. Но я думаю, что скоро они могут нас догнать”, – сказал Хинтон в интервью Би-би-си.

75-летний Хинтон – британско-канадский ученый в области когнитивной психологии и информатики. Его исследования, которым он посвятил десятилетия своей жизни, проложили дорогу современным ИИ-системам, таким как чат-бот Chat GPT.

Уходя из Google, Хинтон пояснил у себя в твиттере, что своей отставкой он не хочет бросить тень на компанию.

“Я ушел, чтобы иметь возможность говорить об опасностях, не волнуясь о том, как это отразится на Google. Google работает ответственно”, – написал он.

Отставка Хинтона добавляет веса голосам специалистов, в последнее время выражающих озабоченность скоростью развития технологий искусственного интеллекта. Недавно открытое письмо об этом подписали предприниматель Илон Маск и сооснователь Apple Стив Возняк.

В письме говорилось о целом ряде рисков: от распространения дезинформации до лишения людей работы и потери контроля над цивилизацией.

“Это сделал бы кто-то другой”

О своей отставке из Google Хинтон изначально сообщил газете New York Times, объяснив, что он отчасти сожалеет о проделанной работе.

“Я утешаю себя обычным оправданием: если бы я этого не сделал, сделал бы кто-то другой”, – поделился ученый в интервью газете.

Объясняя свои опасения в комментарии Би-би-си, Хинтон отметил, что людей должна беспокоить скорость, с которой развиваются технологии в области ИИ.

“Уже сейчас мы видим, как такие системы, как GPT-4, затмевают человека по общей эрудиции, причем с большим перевесом. В том, что касается логического осмысления, она еще отстает, но на простые рассуждения она уже способна”.

“А учитывая нынешнюю скорость прогресса, мы ожидаем, что усовершенствование произойдет довольно быстро. И нас это должно беспокоить”, – добавил ученый.

“Плохие люди, способные на плохие вещи”

Ранее в интервью New York Times Хинтон упоминал опасность того, что ИИ-технологии попадут в руки злоумышленников, которые с их помощью будут делать “плохие вещи”.

Когда Би-би-си попросила его поделиться, кого именно он имеет в виду, Хинтон ответил: “Это самый пессимистичный сценарий. Самый кошмарный прогноз”.

“Представьте себе, например, что какой-нибудь злоумышленник вроде Путина решит дать роботам возможность создавать свои собственные подзадачи”.

Например, в конечном счете, это могут быть такие подзадачи как “Мне нужно усилить свою власть”, – пояснил ученый.

Почему ИИ учится так быстро

Как объяснил Хинтон, у компьютерных систем намного больше возможностей учиться, чем у людей, что вызывает тревогу.

“Мы являемся биологическими системами, а здесь речь идет о цифровых. И огромная разница заключается в том, что с цифровыми системами у вас может быть множество копий с одними и теми же исходными составляющими. Все эти копии могут учиться отдельно друг от друга, а потом мгновенно обмениваться новыми знаниями”.

“Представьте, если бы каждый из 10 тысяч людей узнавал что-то новое, и тут же все 10 тысяч автоматически получали это знание. Вот почему эти чат-боты могут знать намного больше, чем отдельно взятый человек”, – подчеркнул ученый.

Leave a Reply